Avainsana: Etiikka

Sokea tietämättömyys vai tiedostettu hyväksyntä?

Whatsapp on suosittu pikaviestipalvelu, joka oli maailman kolmanneksi ladatuin sovellus 2010-luvulla. Miljoonat ihmiset käyttävät sovellusta päivittäin, mutta kuinka moni on lukenut sovelluksen käyttöehdot ja yksityisyyden suojan? Whatsapp on jakanut jo vuodesta 2016 lähtien sen käyttäjätietoja emoyhtiölle Facebookille muun muassa puhelinnumerosi, ip-osoitteen ja useita lokitiedostoja liittyen sovelluksen käyttöön. Tämän vuoden alussa Whatsapp teki linjauksen, että kaikki ehdot on hyväksyttävä sen uhalla, että sovelluksen käyttö estyy asteittain, lopulta kokonaan. Käyttöehdot ovat monimutkaisia dokumentteja, jotka sisältävät tärkeitä asioita, mutta moni näihin ei tutustu; miksi? [1.] Käyttöehdot 101 Käyttöehdot ovat laillisia dokumentteja, jotka suojaavat yritystä ja selittävät käyttäjälle säännöt, joita alustalla tulee noudattaa. Yleensä käyttöehtoihin on sisällytetty myös tietosuojakäytännöt, jotka puolestaan kertovat käyttäjälle, kuinka hänestä kerätään tietoa, ja kuinka yritys ja kolmannet osapuolet käyttävät tätä tietoa. Sokeasti käyttöehtojen hyväksyminen voi pahimmillaan antaa yritykselle oikeuden myydä käyttäjän tietoja eteenpäin, seurata hänen käyttäytymistään, hänen kännykkänsä tunnisteita tai laitteen IP osoitetta. Facebookin tapauksessa käyttöehtojen hyväksyminen ei rajoitu ainoastaan sen sivuille, vaan yritys kerää tietoa kaikilta laitteilta, joilla henkilö on kirjautunut käyttäjälle. Kaikki tämä on kätketty käyttöehtoihin vaikealukuisella juridisella tekstillä, jotta peruskäyttäjät eivät niitä ymmärtäisi. Useat suuryritykset käyttävät käyttöehtojen kirjoittamisessa omia juristejaan tai ulkopuolisia juridiikan palveluja, jotta käyttöehdoista saataisiin kaiken kattavia suojamuureja käyttäjiä vastaan. [2 : 3, s 14.] Käyttäjälle ei siis jätetä kuin kaksi vaihtoehtoa: joko käyttäjä hyväksyy ehdot ja pääsee käyttämään yrityksen tarjoamaa alustaa tai kieltäytyy ja jättäytyy sosiaalisen median ulkopuolelle. Yksityisyyden paradoksi Käyttöehdot ovat todella pitkiä ja niiden lukeminen on työlästä. Tästä syntyykin mielenkiintoinen kysymys, kuinka moni käyttäjistä sattuu lukemaan ne ennen kuin hyväksyy ehdot. Kaksi professoria Michiganin ja Yorkin yliopistosta loivat testin fiktiivisellä sosiaalisen median sivulla käyttäjille ja tarkoituksena oli selvittää, kuinka moni lukee sivun palveluehdot. Kyselyssä ilmeni, että jopa 74 % hyväksyi ehdot sokeasti, vain neljännes vastanneista avasi ehdot, joista 97 % käytti vain muutaman minuutin yli 4000 sanan käyttöehtojen lukemiseen. [4, s. 17.] Testin tulosten analyysissä kolme merkittävää tekijää nostettiin ylös: informaation ylikuormitus, läpinäkyvyys ja tekstin vaikea ymmärtäminen. Testi viittaa yksityisyyden paradoksiin, jossa käyttäjä arvostaa omaa yksityisyyttään, mutta silti hyväksyy yksityisyyteen liittyviä käyttöehtoja sokeasti. Samalla kuitenkin yksilön tekemät päätökset ovat suoraan ristiriidassa käyttäjän yksityisyyden arvostuksen kanssa, kun käyttöehdot hyväksytään sokeasti. Ongelma läpinäkyvyydessä Sosiaalisen median jätti yritysten toimintaa tiedonkeruun kanssa on vaikea ymmärtää, jos vaikealukuisten käyttöehtojen kohdat jäävät kokonaan lukematta. Kehittäjän tekemien käyttöehtojen tulisi olla selviä, yksinkertaisia ja läpinäkyviä loppukäyttäjälle. Yksinkertainen toiminto, kuten kuvan poistaminen Instagramista, ei oikeasti tarkoita sitä, että käyttäjän poistaessa kuvan profiilista se poistuisi koko sovelluksesta. Instagramin käyttöehtojen mukaan kuva on vielä poistamisen jälkeen 90 päivää sivuston hallussa, ottamatta huomioon sitä, onko jokin toinen käyttäjä tallentanut kuvan ja jakanut sitä eteenpäin. Tätä esimerkiksi ei mainita silloin, kun käyttäjä poistaa kuvan. Hyväksyäkö vai eikö hyväksyä? Ehtojen hyväksyminen ei tee käyttäjästä lammasta muiden joukossa, samalla kun käyttöehtojen hylkääminen ei tee henkilöstä mitenkään parempaa ihmistä muihin verrattuna. Todellisuus on se, että yrityksellä on oikeus määrätä sellaiset käyttöehdot, jotka se kokee tarpeellisiksi. Suurin osa käyttäjistä hyväksyy käyttöehdot ja antaa samalla oikeudet tiedonkeruuseen, jotta heidän käyttökokemuksensa parantuisi. Molemmat osapuolet siis voittavat. Se, että käyttäjä ei halua antaa tietoja yrityksille, ei tarkoita sitä, että hän salaa jotain, mutta siitä ei ole kyse. Facebook kerää miljardien ihmisten tietoja, joten yhden henkilön osuus siitä on mikroskooppisen pieni. Kylmä totuus on se, että käyttäjälle yhteisöön kuuluminen on hyödyllisempää kuin sosiaalisen median yrityksen saama hyöty yksittäisen käyttäjän tiedoista. Molemmat siis hyötyvät: toinen rahallisesti ja toinen yhteisöllisesti. Nykymaailmassa sosiaalisten verkostojen osuus on valtava ja niiden ulkopuolelle jääminen väistämättä johtaa jonkinasteiseen syrjäytymiseen. Lähteet: Newman, L. 2021. WhatsApp’s New Privacy Policy Just Kicked In. Here’s What You Need to Know. Verkkosivusto. Saatavana osoitteessa:<https://www.wired.com/story/whatsapp-privacy-policy-facebook-data-sharing/> Luettu 22.09.2021. Thompson, C. 2015. What you really sign up for when you use social media. Verkkosivusto. Saatavana osoitteessa:<https://www.cnbc.com/2015/05/20/what-you-really-sign-up-for-when-you-use-socialmedia.html> Luettu 22.09.2021. Elshout, M. Elsen, M. Leenheer, J. Loos, M. & Luzak, J. 2016. Study on consumers’ attitudes towards Terms and Conditions. Verkkosivusto. Saatavana osoitteessa:<https://ec.europa.eu/info/sites/default/files/terms_and_conditions_final_report_en.pdf> Luettu 23.09.2021. Obar, J. & Oeldorf-Hirsch, A. 2016. The biggest lie on the internet: Ignoring the privacy policies and terms of service policies of social networking services. Verkkosivusto. Saatavana osoitteessa <https://www.ftc.gov/system/files/documents/public_comments/2016/10/00067-129185.pdf> Leuttu 23.09.2021 Kuva <https://www.someecards.com/usercards/viewcard/MjAxMi1mY2RjNzVjZTJlNjdlZmIw/?tagSlug=news> Kirjoittajat: Hyvinvointi- ja terveysteknologian kolmannen vuoden opiskelijat Tuomas Turunen, Ilkka Törmälä ja Henrik El-Khouri.

Itseohjautuvat autot moraalisessa tienristeyksessä

Lähitulevaisuudessa tullaan näkemään monien alojen täydellinen automatisoituminen, eikä autoala ole tässä poikkeus. Tässä blogissa käsitellään itseohjautuviin autoihin liittyviä eettisiä ongelmia, joista esimerkkeinä käytämme kirjoittamisen aikana kuumina aiheina olevia Teslan ja monien muiden suurten autovalmistajien itseohjautuvia autoja. Vaadittava teknologia itseohjautuvien autojen siirtymiseen pysyvästi ideasta käytäntöön on jo olemassa. Ensin pitäisi kuitenkin päättää, miten ne käyttäytyvät liikenteessä ja kuka sen päätöksen tekee. Kun tietä ylittää punaisia valoja päin toiselta puolelta koditon henkilö ja toiselta toimitusjohtaja, kumman pitäisi selvitä ylityksestä? Tämänkaltaiset päätökset voivat olla itseohjautuvien autojen ratkaistavissa jo pian. Siihen, miten itseohjautuva auto ohjelmoidaan käyttäytymään, vaikuttaa entistä suuremmissa määrin ihmisten henkilökohtaiset lähtökohdat. Ihmisten moraalista kompassia ohjaavat muun muassa heidän sosiaaliset näkemyksensä ja kyky osoittaa empatiaa riippumatta siitä, kuinka korkealla henkilö on yhteiskunnallisessa hierarkiassa. Mitä suuremmat erot maassa on ihmisten sosiaalisessa statuksessa, sitä todennäköisemmin he valitsevat itseohjautuvan auton uhraamaan kodittoman ihmisen. Ihmiset maista, joissa ero köyhien ja rikkaiden välillä on suhteellisen pieni, eivät tutkimusten mukaan käänny selkeästi kumpaakaan osapuolta vastaan. Vaihtoehtoisesti ihmiset haluaisivat auton tilanteen salliessa ohjaamaan itsensä tieltä ulos tai jopa viereiseen betoniseinään, riskeeraten matkustajan hengen [1]. Autonvalmistajat tekevät tietyllä tapaa moraalisen valinnan jo päätettäessään missä ja kuka heidän itseohjautuvat autot suunnittelevat. Pitäisikö autonvalmistajien siis keskittää itseohjautuvien autojen kehitys johonkin tiettyyn maahan, joka vastaisi mahdollisimman hyvin heidän omaa moraalista kantaansa tässä asiassa? Valmistajilta on kuitenkin turha odottaa suoraa vastausta kysymykseen siitä, kenet heidän itseohjautuva auto on ohjelmoitu uhraamaan tilanteessa, jossa törmäys ihmiseen ei ole enää estettävissä. Isona pelkona itseohjautuvien autojen kehittyessä on tietenkin se, että kuljettajat tulevat menettämään työnsä. Tämän myötä tulee esille myös toinen ongelma: Miten itseohjautuvat autot aikovat valita tulevaisuudessa asiakkaansa? Pelkona on, että autonvalmistajat antavat teknologian identifioida ihmisiä ja luoda erilaisia “profiileja” heistä ulkonäön, taustan sekä rodun perusteella. Silloin auto pystyisi valitsemaan ns. parhaat ja varakkaimmat asiakkaat, jolloin kaikki ihmiset eivät mahdollisesti saisi tasavertaista palvelua. Tämänkaltainen toimintamalli voi myös pidemmällä aikavälillä tuoda esille isoja ongelmia, jos tietty väestö joutuu kärsimään sen seurauksena. EU:ssa laaditaan parhaillaan yhteistä sääntelyä itseohjautuville autoille [3]. Haasteita riittää niin tietoturvallisuuteen liittyvissä kuin eettisissäkin kysymyksissä. Kuinka taata tasa-arvoinen kohtelu kaikille ihmisryhmille? Erityisesti miten otetaan huomioon liikuntavammaiset tai lapset liikenteessä? Teknologia kehittyy niin nopeasti, että lainsäädäntö laahaa auttamatta perässä. EU:n on tärkeä tehdä yhteistyötä jäsenmaiden kanssa varmistaakseen yhteneväiset lait, jotta kansalaisten luottamus itseohjautuviin autoihin voidaan taata. Lainsäädännön on ehdottoman tärkeää olla ajan tasalla, tai liikennettä uhkaavat viidakon lait. Lähteet: Self driving car dilemmas reveal that moral choices are not universal. (24.10.2018). Haettu osoitteesta https://www.nature.com/articles/d41586-018-07135-0 Gitlin, J. Real robotaxi gets a step closer in San Francisco. (13.5.2021). Haettu osoitteesta https://arstechnica.com/cars/2021/05/real-robotaxi-service-gets-a-step-closer-in-san-francisco/ Itseohjautuvat autot pian todellisuutta EU:ssa. (14.1.2019). Haettu osoitteesta https://www.europarl.europa.eu/news/fi/headlines/economy/20190110STO23102/itseohjautuvat-autot-pian-todellisuutta-eu-ssa Kirjoittajat: Hyvinvointi- ja terveysteknologian pääaineopiskelijat Jan Buben, Pekko Lehto ja Mika Åberg Hyvinvointi- ja terveysteknologia on yksi tieto- ja viestintätekniikan tutkinto-ohjelman ammatillisista pääaineista.

Kenelle kaatuu vastuu tekoälystä?

Tekoälystä on tullut yksi tekniikan alan suosituimmista puheenaiheista viime vuosina. Aiheesta riittääkin keskusteltavaa, sillä tekoälyn implementoiminen arkiseen elämään herättää valtavasti kysymyksiä siitä, mikä tekoälyn roolin tulisi olla. Paljon erimielisyyksiä puhujien keskuudessa on syntynyt varsinkin eettisistä ongelmista liittyen vastuunkantoon mahdollisissa ongelmatilanteissa. Kenen vastuulla esimerkiksi on, jos tekoäly tekee henkilövahinkoon johtavan virheen? Heikko ja vahva tekoäly Tekoälyn määrittelyssä on paljon ongelmia muun muassa sen suhteen, mikä lasketaan tekoälyksi ja mikä ei. Usein törmätään määrittelyihin heikosta ja vahvasta tekoälystä, joista heikko tekoäly kykenee muuttamaan itsenäisesti yksittäistä prosessia, johon se on ohjelmoitu, kun taas vahvaa tekoälyä ei välttämättä erota ihmisestä ollenkaan. On mielenkiintoista, miten tekoälylle voidaan asettaa eettisiä tai moraalisia toimintaoletuksia, jos sitä kohdellaan yhteiskunnassa kuin orjaa, jolla ei ole täysiä oikeuksia elämäänsä.[1.] Mikä on se raja, joka vedetään vastuunkantoon, ja mitkä ovat kriteerit, joilla se perustellaan? Antiikin kreikassa Aristoteles jo ajatteli tätä dilemmaa ja tiivisti ajatuksensa vapaaseen tahtoon ja tietoisuuteen. Mikäli olennolla ei olisi näitä, ei sitä myöskään voitaisi asettaa vastuuseen teoistaan[3]. Riippuen tekoälyn lopullisesta toteutustavasta olisi kiintoisaa tietää, voiko esimerkiksi itseään ajava auto katkeroitua siitä, ettei sen anneta olla, mitä se todellisuudessa haluaisi olla, eli vaikkapa lentokone. Tällöin vahvan tekoälyn ohjaama auto voisi alkaa täysin ihmisen huomaamatta kapinoida ihmistä vastaan muuttumalla vähemmän turvalliseksi ja hankkiutua tilanteisiin, joissa se saa oman toimintansa näyttämään sallitulta ja hyväksytyltä.[2.] Heikon tekoälyn ohjaama auto taas on ohjelmoitu joidenkin senhetkisten kriteerien perusteella riittävän turvalliseksi. Sama pätee myös muihin tekoälyjärjestelmiin, kuten kuvantamislaitteisiin ja niiden tulkinta- algoritmeihin, jotka toimivat diagnostiikan apuvälineinä.[2;3.] Onko mahdollista varmentaa, mitä ei itse ymmärrä? Mikäli tekoälyn turvallisuuden rajoista kirjoitetaan joskus laki, valtiot voivat käytännössä etukäteen määritellä, kuinka monen ihmisen kuolema voi olla hyväksyttävissä. Tällöin laitteen valmistajalta putoaa tietyssä mielessä vastuu laitteen turvallisuudesta, kunhan laissa määritelty kuolonuhrien määrä ei ylity.[2.] Olisi kuitenkin kiinnostava miettiä tilannetta, jossa valmistaja itse asiassa kykenisi valmistamaan paremman laitteen kuin mitä laissa vaaditaan. Tekoälyn turvallisuuden määrittelee pitkälti sen ”ohjelmiston” optimointi, jonka kehityksestä vastaa tekoälyn valmistaja. On epäselvää ja järjestelmäriippuvaista, miten raskasta työtä tekoälyn ohjelmistokehitys tulee tulevaisuudessa olemaan, mutta selvää on se, että mitä optimoidummaksi valmistaja ohjelmiston haluaa, sitä kalliimmaksi sen kehitys valmistajalle tulee. Valmistaja törmää eettiseen ongelmaan: valmistaako mahdollisimman turvallinen järjestelmä, vai sijoittaako vähemmän rahaa riittävän hyvään, huonompaan järjestelmään. Yksinkertaisimmillaan tämänhetkisessä maailmassa vastuu tekoälyn toiminnasta kaatuisi sen valmistajan tai sitä käyttävän asiantuntijan niskaan, koska tekoäly mielletään koneeksi. Jos kuitenkin vastassa on pitkälle kehittynyt vahva tekoäly, joka on luonut paljon omia näkemyksiään, voidaanko enää edes olettaa, että edes asiantuntija ymmärtäisi tekoälyn johtopäätöksiä. Onko mahdollista varmentaa, mitä ei itse ymmärrä? Yksi vaihtoehto olisi rajoittaa tekoälyä tietyillä osa-alueilla, jotta se olisi ymmärrettävämpi ja käyttäjäystävällisempi.[3.] Herää kuitenkin eettinen ongelma, jos ajatellaan samanlaista toimintamallia ihmiseen. Kestäisikö kukaan ihminen järjissään, jos toinen ihminen voisi lukea kaapelilla toisen ihmisen ajatuksia? Miten ihminen tässä tilanteessa eroaisi enää koneesta, kun vapaata tahtoa voitaisiin pahimmassa tapauksessa jopa muokata ja vähintäänkin rajoittaa? Tekoälyn käyttö siirtää usein harkintavaltaa ulkoisille toimijoille, kuten it-asiantuntijoille sekä data-analyytikoille, joiden työtä on vaikeampi tutkia julkisesti. Esimerkiksi hallitus käyttää yksityisiä tekoälyjärjestelmiä päätöksenteon tukena todellisuudessa tietämättä lainkaan, miten tekoäly päätöksensä tekee. Tekoälyn käyttöön osallistuu aina toimijoita, jotka eivät ole riittävän tietoisia omasta vastuustaan estää tekoälystä johtuvia haittoja tai jotka eivät ole motivoituneita ymmärtämään järjestelmää.[4.] Toisaalta ihmiset eivät välttämättä edes ole itse tietoisia, onko tekoäly osallistunut päätöksentekoon heihin kohdistuvissa asioissa. Miltä näyttää siis tulevaisuus tekoälyn suhteen? Tuleeko tekoäly kehittymään niin pitkälle, että vastuun antamista sille voidaan edes moraalifilosofiselta saati sitten lainsäädännölliseltä kannalta miettiä, vai jatkuuko vastuun kantaminen yrityksillä ja asiantuntijoilla? Se, missä lainsäädännön toivoisi tulevan vastaan, on tietynlaisten raamien luominen tekoälyn kehitykselle, jotta yritys- ja asiantuntijavastuuta ei voi pitää kohtuuttomana. Lähteet: Mitä tekoäly on?. Verkkosivusto. Saatavana osoitteessa <https://xn--tekolyeua.info/mita_tekoaly_on/>. Luettu 23.09.2021 Hevelke, A., Nida-Rümelin, J. Responsibility for Crashes of Autonomous Vehicles: An Ethical Analysis. Sci Eng Ethics 21, 619–630 (2015). Saatavana osoitteessa <https://doi.org/10.1007/s11948-014-9565-5>. Neri, E., Coppola, F., Miele, V. et al. Artificial intelligence: Who is responsible for the diagnosis?. Radiol med 125, 517–521 (2020). Saatavana osoitteessa <https://doi.org/10.1007/s11547-020-01135-9>. Santoni de Sio, F., Mecacci, G. Four Responsibility Gaps with Artificial Intelligence: Why they Matter and How to Address them. Philos. Technol. (2021). Saatavana osoitteessa <https://doi.org/10.1007/s13347-021-00450-x>. AI Truth Machine / LIT Law Lab, Johannes Kepler University (AT). Kuva. Saatavana osoitteessa <https://www.flickr.com/photos/arselectronica/50224297163>. Samee, Shadman. Beetle beside the runway. Kuva. Saatavilla osoitteessa <https://www.flickr.com/photos/shadman_samee/39989484632/>. Kirjoittajat: Hyvinvointi- ja terveysteknologian opiskelijat Aapo Kokko ja Julius Marttunen sekä sähkö- ja automaatiotekniikan opiskelijat Benjami Lindqvist ja Julius Velasco.

Tekoäly, ihmiskunnan yhteinen lapsi

Tekoäly on ollut kanssamme jo jonkin aikaa. Ihmiset alkavat huomata, miten paljon erilaisia tekoälyjä me käytämme päivittäin. Näitä ovat esim. chatbotit, itseajavat autot, videoita ehdottavat ehdotus-botit. Tekoälystä on monia eri tasoja, tällä hetkellä käytössä on tekoälyjä, jotka pystyvät noudattamaan niille annettuja käskyjä. Tulevaisuudessa tekoäly tulee olemaan paljon kehittyneempi, ja sillä saattaa olla paljon enemmän valtaa ja vaikutusta meidän elämäämme. Tällainen on esimerkiksi terveysalalla ihmisiä diagnosoiva tekoäly. Siksi on tärkeää opettaa tekoälylle, kuinka sen kuuluisi käyttäytyä ihmisten kanssa. Voisiko tekoälyn adoptoida ja voisiko sen kasvattaa kuin omana lapsena? Voiko tekoälyä oppia tuntemaan kuin ihminen, voiko se olla empaattinen ja lämmin? Voiko tekoäly koskaan ymmärtää, että oikean ja väärä välissä on aina harmaa rajamaasto? On puhuttu, että jonain päivänä tekoäly pystyisi korvaamaan monen työntekijän osaamisen alalla kuin alalla. Mutta pitääkö tämäkään paikkaansa, tekoäly kyllä pystyy tekemään nopeampia päätöksiä ja on harvemmin väärässä kuin ihminen. Mutta jos se ei opi empaattiseen kanssakäyntiin, niin ei se pysty korvaamaan ihmistä. Tekoälyn älykkyydestä vastaa ihminen Tekoäly on työkalu, ja kuten mitä tahansa työkalua, sitäkin voi käyttää hyvään tai pahaan (1). Ihminen on suuressa vastuussa, kun puhutaan tekoälyn luonnista. Ihminen voi määrittää, miten tekoäly ottaa huomioon ihmiset päätöksenteossa ja miten se käyttäytyy ihmisten kanssa. Tekoälyn käyttö lisääntyy maailmalla, tämän vuoksi sille pitää opettaa hyvän ongelmanratkaisukyvyn lisäksi eettistä ajattelua. Tekoälyn pitää oppia eri ihmisryhmistä ja kulttuureista, jotta sen toiminta ei olisi syrjivää tai loukkaavaa. Tekoäly ja tunteet Tekoälyn kehittyminen on herättänyt paljon pohdintaa sen riskeistä ja etiikasta. Yhtenä esimerkkinä voisi toimia tilanne, jossa autoa ohjaisi tekoäly ja sen pitäisi tehdä valinta, kumman osapuolen pelastaisi, jos vaihtoehtona olisi törmätä yhteen tai kahteen henkilöön tilanteesta riippuen. Ongelmana tässä olisi kuitenkin se, että ei ihminenkään pystyisi välttämättä tekemään oikeaa valintaa tällaisessa tilanteessa ja mikä loppujen lopuksi olisikaan sitten se oikea valinta. Näin emme myöskään sitä osaa kertoa tekoälylle tai kehitellä tilanteeseen sopivia algoritmejä. Tekoälyn haasteena onkin se, että se voi kehittyä väärille tavoille ja kehittää omia sääntöjä, jotka eivät välttämättä ole hyväksyttäviä eettisesti. On puhuttu myös niin sanotusta mustan laatikon ongelmasta, eli tekoäly voi kehittää algoritmeja, joiden seuraaminen ja ymmärtäminen on ihmiselle vaikeaa (2). Mustan laatikon ongelma on hankala asia, jos yritetään opettaa sääntöjä tekoälylle, koska tällöin pitäisi tietää, miten monimutkaisesti tekoäly tekee ratkaisunsa ja näin ollen ohjelmoijan tekemät algoritmit määrittelevät paljon tekoälyn toimintaa. Sääntöjen opettaminenkaan ei välttämättä takaa, ettei ongelmia tulisi tekoälyn kanssa. Tekoälyn olisi hyvä nimittäin huomata ja tehdä muutoksia jo ohjelmoituihin sääntöihin. Tämä kuitenkin onnistuisi vain, jos tekoäly huomioisi ihmisen tunteet ja oppisi niistä. Se kuitenkin vaatisi tekoälyltä mahdollista sosiaalista toimintaa tai sen seuraamista. Tästä saisi myös mahdollisesti hyviä ohjeita ja apuja, joiden avulla tekoäly voisi muokata ja korjata eettisiä käsityksiään. Tekoäly erehtyy ihmistä harvemmin Teknologiayrityksissä mietitään, mitä eri mahdollisuuksia tekoäly pystyy tarjoamaan. Terveysteknologia alalla ollaan jo hyvin pitkällä. Tekoälystä on mahdollista saada apua hoitotarpeen arviointiin ja varhaiseen diagnostiikkaan. Tekoäly pystyy esimerkiksi ennustamaan keskosvauvojen infektion jopa päivää ennen sen puhkeamista (3). Samaan pystyisi hyvä hoitaja, mutta heitä ei ole aina saatavilla. Tekoäly myös erehtyy ihmistä harvemmin, ja ihmisille sattuu inhimillisiä virheitä toisin kuin tekoälylle. Yksi tekoälyyn liittyvä pelko on mm. kuinka luotettava ja turvallinen tekoäly pystyy olemaan. Tekoäly todennäköisemmin tekee vähemmän vääriä diagnooseja kuin ihminen. Turvallisuus on hyvin tarkasti valvottu ala, koska jos tuotteella CE-merkintä siihen voi luottaa ja samalla on myös huolehdittu potilasturvallisuudesta. Myös sitä pelätään, että tekoäly vie työpaikat. Se on hyvin kaikkien tiedossa, että terveydenhuollossa loppuvat kädet. Hoitajien täytyy juosta ympäriinsä, jotta kerkeävät kaikkialle. Tylsä työ kannattaa siirtää tekoälylle ja robotille. Ihminen erehtyy tekoälyä useammin, mutta ei tekoälykään ole aina täysin oikeassa. Esimerkiksi Facebookin tekoäly on luokitellut tiettyjä ihmisryhmiä gorilloiksi. Tulevaisuudessa tekoäly epäilemättä vie työpaikkoja ihmisiltä. Aina tarvitaan kuitenkin joku huoltamaan ja korjaamaan ja päivittämään ihmiskunnan yhteistä lasta. Lähteet: Laitio Paula. 2021. https://www.vere.fi/teko%C3%A4lyn-%C3%A4lykkyydest%C3%A4-vastaa-ihminen. Luettu 23.9.2021 Rydenfelt Henrik. 2017. https://etiikka.fi/tekoaly-ja-tunteet/. Luettu 23.9.2021 Kaukonen Sini. 2018. https://teknologiateollisuus.fi/fi/ajankohtaista/artikkeli/tekoaly-erehtyy-ihmista-harvemmin. Luettu 23.9.2021 Tuomas Linnake. 2021. https://www.is.fi/digitoday/art-2000008243943.html. Luettu 23.9.2021 Kirjoittajat: Hyvinvointi- ja terveysteknologian kolmannen vuoden opiskelijat Laura Kesti, Leo Kortevaara ja Ann-Mari Räsänen. Hyvinvointi- ja terveysteknologia on yksi tieto- ja viestintätekniikan tutkinto-ohjelman ammatillisista pääaineista. Hyvinvointi- ja terveysteknologiaan erikoistuneet insinöörit hallitsevat itse teknologian lisäksi teknologian käytännön soveltamiseen,käytettävyyteen ja regulaatioon liittyvät näkökulmat.

Tappaako tekoäly hoivatyön inhimillisyyden?

Katoaako ihmisyys kun robotit ja tekoäly ottavat jalansijaa hoitoalalla ja osallistuvat yhä enemmän hoitotyön sosiaaliseen puoleen? Onko robotin empatia ja tuki samanarvoista kuin ihmisen? Robottien ja tekoälyn hyödyntämisellä työssä ja työpaikoilla tavoitellaan tehokkaampaa ja turvallisempaa tapaa tehdä töitä. Hoitotyössä robotteja on tarkoitus erityisesti hyödyntää mekaanisiin ja fyysistä rasitusta tuottaviin työtehtäviin. Robottien hyödyllisyys esimerkiksi lääkeannosteluissa ja tavaroiden kuljetuksessa on selkeä, sillä ne vapauttavat henkilökuntaa muihin työtehtäviin. Tekoäly tekemässä päätöksiä hoitotyössä puolestaan nähdään vielä osittain uhkana. Muilla osa-alueilla tekoälyyn ja sen tekemiin päätöksiin luotetaan, esimerkiksi karttasovellusten reittivalinnoissa tai hakukoneiden tuloksissa, sillä usein ei tiedetä päätösten olevan peräisin tekoälyltä. Miten käy ihmisyyden, kun robotit tulevat? Hoitotyössä tekoäly ja robotiikka nähdään usein ihmisen kaltaisena ja piirteet omaavana robottina, joka toimii yhtenä hoitajista tehden samoja työtehtäviä ja päätöksiä kuin hekin. Kuitenkaan tekoäly ei nauti samanlaista luottamusta kuin hoitajat. Hoitotyössä tekoäly ja koneet nähdään usein uhkana ihmisyydelle ja viemässä potilailta kosketuksen muihin ihmisiin. Uskonnonfilosofian dosentti, akatemiatutkija Aku Visala [2] on pohtinut seuraavaa: “Jos ulkoistamme huolenpidon ja hoivan koneille, riistämme itseltämme ja toisiltamme moraalisen kasvun ja sitoutumisen mahdollisuuden. ” Vievätkö koneet todellakin meiltä mahdollisuuden välittää ja ottaa kontaktia vai voiko asiaa ajatella toiselta kantilta? Kun palvelurobotit hoitavat fyysistä työtä vaativat välttämättömyydet, jää hoitajalle tai läheiselle aikaa kohdata ihminen ihmisenä, ei potilaana. Kun ei tarvitse huolehtia siitä, miten aika riittää hoitotoimenpiteiden suorittamisen lisäksi myös keskusteluun ja kanssa oloon, voimme olla todella läsnä. Miten voisimme tuomita mahdollisuuden saada huomiota ja läheisyyttä vaikka “vain” koneelta? Jos ihminen kokee tämän itselleen riittäväksi, eikö jokaisella ole oikeus tehdä päätös omalla kohdallaan? Olisiko todella eettisempi ratkaisu vaatia vanhusta istumaan yksin hoivakodissa, koska vaihtoehtona olisi tarjota “empatian ja välittämisen simulaatiota, ei aitoa välittämistä”? Vähentääkö se fakta, että koneen välittäminen on simulaatiota, sen arvoa? Lopulta kuitenkin koneen antama empatia on meidän teknologiaa kehittävien ihmisten empatiaa. Yksilöityä hoitoa robottien turvin Monelle vanhukselle saattaisi olla jopa helpompaa antaa koneen hoitaa tietyt työt, kuin antaa intiimiä kanssakäymistä vaativat tehtävät läheiselle. Oman toimintakyvyn heikkeneminen on oletettavasti monelle vanhukselle haastavaa hyväksyä, jolloin esimerkiksi palvelurobotiikan käyttö hoitotyössä tulisikin olla aina kohdennettua. Tällöin pystymme ottamaan huomioon kunkin potilaan tarpeet ja toiveet. Olisiko siis väärin tarjota yksinäiselle vanhukselle tekoälyä pitämään seuraa, kun hän on yksinäinen tai kaipaa tekemistä? Löytyyhän tekoälyä esimerkiksi peleistä. Pelit mielletään usein nuorten ihmisten hauskanpidoksi, mutta miksi niistä eivät voisi myös vanhukset nauttia? Tekoäly voi esimerkiksi esiintyä pelikaverina. Monissa peleissä tekoäly toimii vastustajana, kuten esimerkiksi shakissa, joka haastaa loogista ajattelukykyä. Kuntoutusmuotona peli varmasti lisäisi motivaatiota ja aktivoisi vanhusta saavuttamaan omat henkilökohtaiset sekä terveyteen liittyvät tavoitteet. Yksinäiselle vanhukselle pelillä voi olla suuri vaikutus hänen mielialaansa ja vireyteen, eikä muuta tekoälyä silloin vaadita hoitotyön tukena. Miten tekoäly terveydenhoitoaloilla tulee vaikuttamaan insinöörien ja hoitajien työhön tulevaisuudessa? Saadaanko uusista innovaatioista tarpeeksi jossain kohtaa, vai voidaanko miettiä, kuinka pitkälle tekoäly kehittyy kyseisellä alalla? Tekoäly tulee mahdollistamaan uusia menetelmiä niin hoito- kuin tekniikan alalla. Jatkuvasti kehittyvä teknologia ja uudet mahdollisuudet johtavat myös jatkuvasti uusien eettisten pohdintojen äärelle. Kun teknologia kehittyy, täytyy tekijänkin kehittyä eikä jäädä jälkeen. Tulevaisuus on täynnä uhkia ja mahdollisuuksia, ja niistä on opittava kehittymään aina nykypäivän tilanteesta parempaan suuntaan. Lähteet: Valpe, K. 29.1.2019. Ihmisten hyvinvointi keskiössä Tekoäly terveydenhuollossa -loppuseminaarissa. Verkkosivusto. Saatavana osoitteessa <https://jyunity.fi/wp-content/uploads/2019/01/kansansairaudet_1240x600-1024x496.jpg> Luettu 24.9.2021 Rautio, Pekka. 2.5.2018. ”Kun tekoäly kehittyy, ihmisen konemaisuus on suurempi ongelma kuin koneiden ihmismäisyys”. Verkkosivusto. Saatavilla osoitteessa <https://www.helsinki.fi/fi/uutiset/opetus/kun-tekoaly-kehittyy-ihmisen-konemaisuus-suurempi-ongelma-kuin-koneiden-ihmismaisyys> Luettu 22.9.2021 Pixabay. TheDigitalArtist. 10.4.2018. Verkkosivusto. Saatavilla osoitteessa <https://pixabay.com/fi/photos/yhteys-k%c3%a4si-ihmisen-robotti-3308188/> Luettu 24.9.2021 Kirjoittajat: Hyvinvointi- ja terveysteknologian kolmannen vuoden opiskelijat Emilia Larmala, Laura Mikluha, Miika Honni ja Nina Lamponen Hyvinvointi- ja terveysteknologia on yksi tieto- ja viestintätekniikan tutkinto-ohjelman ammatillisista pääaineista.

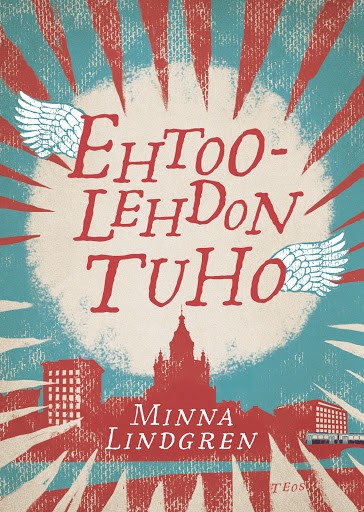

Toisinaan on älyssä pitelemistä

Älyseinä, älyavain, älyjääkaappi, Kuntokonsolikeskus, lääkkeitä jakava entinen vihivaunu, paijattava hyljerobotti, VirtuLääkäri, hoivarobotti Ahaba. ”Tää on tätäpäivää”, sanoisi KäyttöpäällikköLähituki Jerry Siilinpää, hoivakoti Ehtoolehdon ainoa varsinainen työntekijä. Hoitohenkilökunta on korvattu hyvinvointiteknologian uusimmilla saavutuksilla, ja asiakkaat - muun muassa lähes satavuotiaat Siiri, Anna-Liisa ja Irma - yrittävät tulla toimeen uudessa ja uljaassa maailmassa. Minna Lindgrenin romaani Ehtoolehdon tuho (Teos 2015) on ajankohtainen ja räväkkäkin kommentti meneillään olevaan automatisaatio-, robotisaatio- ja digitalisaatiokeskusteluun. Siinä aikaisemmista teoksista tuttu Ehtoolehto-niminen palvelutalo on muuttunut tulevaisuuden palvelukonseptin pilotiksi, monitoroidun hoivan palveluyksiköksi. Siiri, Anna-Liisa ja Irma sekä monet muut heidän kohtalotoverinsa elävät oman onnensa ja nykyaikaisen teknologian nojassa kuin viimeistä päivää. Tuulahduksina oikeasta elämästä ovat vain herätysliikkeiden vierailijat ja rotat. Vanhusten ja teknologian yhteispelissä on mukana aimo annos huumoriakin: ”Elämä älytalossa oli hyvinkin lystikästä, kun osasi suhtautua koneiden järjestämiin yllätyksiin vastaanottavaisesti.” Viime kädessä Lindgrenin romaanissa on kuitenkin vankka eettinen pohjavire. Se pakottaa kysymään, ovatko Ehtoolehdon vanhukset todellisuudessa hoivan vai valvonnan kohteena. Jotkin teknologiset ylilyönnit saavat Siirin ja Irman käymään kamppailuun ihmisläheisemmän huomisen puolesta. Kirjan loppu voi tuoda mieleen vaikkapa Asterix-sarjakuvateoksen Jumaltenrannan nousu ja tuho, jossa haluttu suuri muutos sortuu omaan mahdottomuuteensa. Aihetta seminaariin Joissain arvioissa on suositeltu Lindgrenin Ehtoolehto-trilogiaa pakolliseksi luettavaksi sosiaali- ja terveysalalle. Roboreelin hengessä Ehtoolehdon tuhoa voi suositella sote- ja tekniikan alan opiskelijoille yhteiseksi luettavaksi. Se avaa pohdittavaksi monenlaisia näkökulmia siihen, millaisia muita asioita kuin pelkästään teknisiä on hyvä ottaa huomioon esimerkiksi robotiikkakokeilujen yhteydessä. Lindgrenin romaanilla on vahvuutenaan kaunokirjallisuuden yleisesti tunnustettu supervoima: mielikuvitus. Miten muuten alle kolmekymppinen hyvinvointiteknologiaan suuntautuva opiskelija pystyisi eläytymään yhdeksänkymppisen, lähes liikuntakyvyttömän vanhuksen elämään kuin käyttämällä mielikuvitustaan? Tutustumisen yhteydessä voisi järjestää seminaarin, jossa eri alojen opiskelijat vertailevat näkemyksiään romaanin herättämistä ajatuksista vaikkapa juuri hyvinvointiteknologian merkityksestä. Samassa seminaarissa kannattaisi kaunokirjallisen teoksen rinnalla tarkastella Terhi Solanterän tuoretta (2020) tutkimusta Robotiikka ikääntyvän väestön kotona asumisen ja hoivapalveluiden tukena. Yhdessä teokset luovat lavean näkymän meneillään olevaan kehitykseen - ja antavat tekemisen tueksi mahdollisuuden luoda yhteisen vision tavoittelemisen arvoisesta tulevaisuudesta. Kirjoittaja: Pasi Lankinen työskentelee suomen kielen ja viestinnän yliopettajana Metropolia Ammattikorkeakoulussa.